L’intelligence artificielle (IA) suscite des inquiétudes parmi les experts, dont Paul Christiano, ancien chercheur clé d’OpenAI.

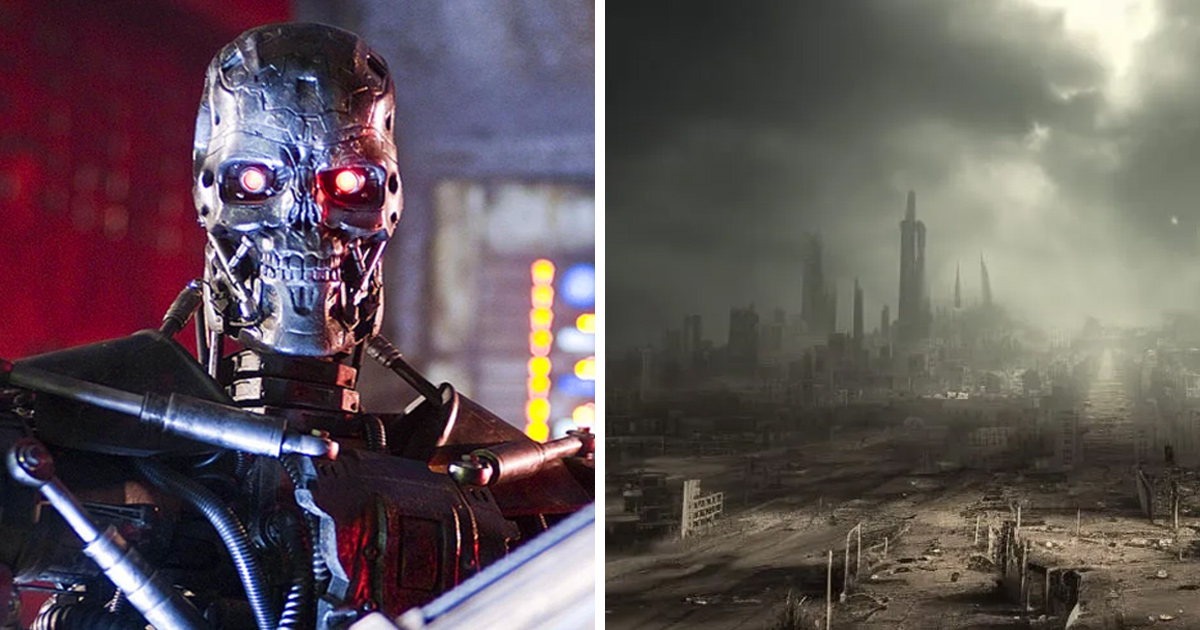

M. Christiano, qui dirige aujourd’hui l’Alignment Research Center, estime qu’il existe un risque important que l’IA prenne le contrôle de l’humanité et provoque sa destruction. Il insiste sur la nécessité de prendre en compte les risques potentiels associés aux progrès de l’IA.

M. Christiano s’inquiète du moment où les systèmes d’IA atteindront le même niveau de capacité logique et créative que les êtres humains, estimant à 50 % le risque qu’une catastrophe se produise peu de temps après, rapporte Decrypt.

Cette inquiétude est partagée par de nombreux scientifiques du monde entier, comme en témoigne une lettre en ligne signée par un grand nombre d’entre eux, appelant à une pause dans le développement de l’IA.

D’éminentes personnalités comme Elon Musk et Bill Gates ont également fait part de leurs appréhensions, soulignant la menace existentielle que représente une IA non réglementée.

Ces inquiétudes sont dues à la façon dont l’IA apprend à travers des quantités massives de données et à sa capacité à atteindre des objectifs en analysant et en interprétant des informations.

L’apprentissage automatique a permis à l’IA de fournir des réponses cohérentes à des requêtes humaines en exploitant de vastes ensembles de données obtenues sur Internet.

En outre, l’amélioration continue de la puissance de traitement des ordinateurs, combinée aux capacités de l’IA, a conduit certains scientifiques à penser que les machines pourraient développer une sensibilité et une conscience de soi au cours de la prochaine décennie.

Compte tenu de ces risques potentiels, les chercheurs préconisent la mise en place de mesures de protection pour contrôler le comportement de l’IA.

La surveillance des systèmes d’IA permet d’intervenir et de contrôler, ce qui minimise les risques de conséquences négatives.

Toutefois, l’absence de réponse à ces préoccupations pourrait avoir des conséquences catastrophiques, comme l’a mis en garde le cofondateur d’OpenAI.

Pour éviter un tel scénario, il est essentiel d’établir de manière proactive des lignes directrices et des réglementations afin de garantir le développement sûr et responsable des technologies de l’IA.

Ce faisant, nous pourrons exploiter les avantages de l’IA tout en atténuant les risques qui y sont associés, préservant ainsi le bien-être de l’humanité dans un monde de plus en plus dominé par l’IA.